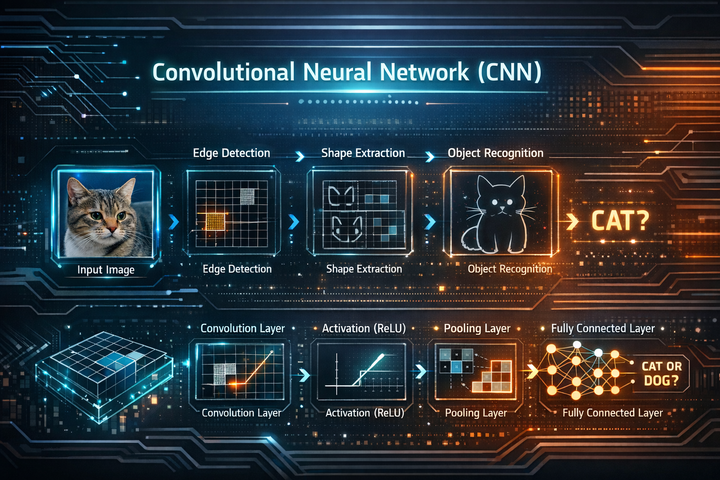

CNN: จากพิกเซลสู่ความเข้าใจ

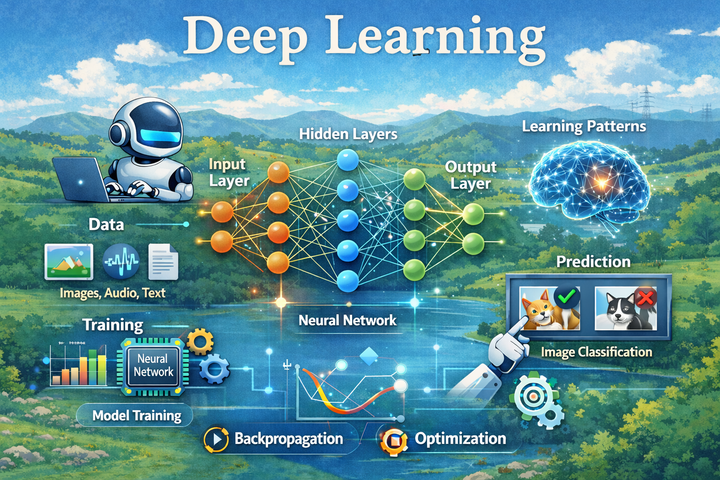

CNN (Convolutional Neural Network) คือโมเดล Deep Learning ที่ออกแบบมาเพื่อ เข้าใจข้อมูลที่เป็นภาพ (Image) โดยเฉพาะ แต่ปัจจุบันยังนำไปใช้กับเสียง วิดีโอ และข้อมูลเชิงพื้นที่อื่น ๆ ได้ด้วย

“สมองที่ค่อย ๆ มองภาพจากรายละเอียดเล็ก ไป