AI Hallucination เกิดจากอะไร?

หลายครั้งที่เราเริ่มใช้ AI แล้วเจอเหมือนกัน

AI ตอบเหมือนมั่นใจมากแต่ข้อมูลจริงกลับผิด

สิ่งนี้เรียกว่า AI Hallucination

จริงๆ แล้ว LLM อย่าง GPT ไม่ได้ “รู้” ว่าอะไรจริงแต่มันทำงานโดยการ

“ทำนายคำถัดไปที่น่าจะเกิดขึ้นมากที่สุด”

ดังนั้นเวลาข้อมูลไม่พอหรือคำถามกว้างเกินไป AI จะเริ่ม เติมช่องว่าง เอง

เช่น

- สร้างข้อมูลปลอม

- อ้างอิงงานวิจัยที่ไม่มีจริง

- ตอบมั่นใจทั้งที่ผิด

จุดสำคัญ คือ AI ถูกออกแบบให้ “ตอบลื่น”ไม่ใช่ “ตอบแบบลังเล”

วิธีลด Hallucination ที่ดีที่สุดคือ

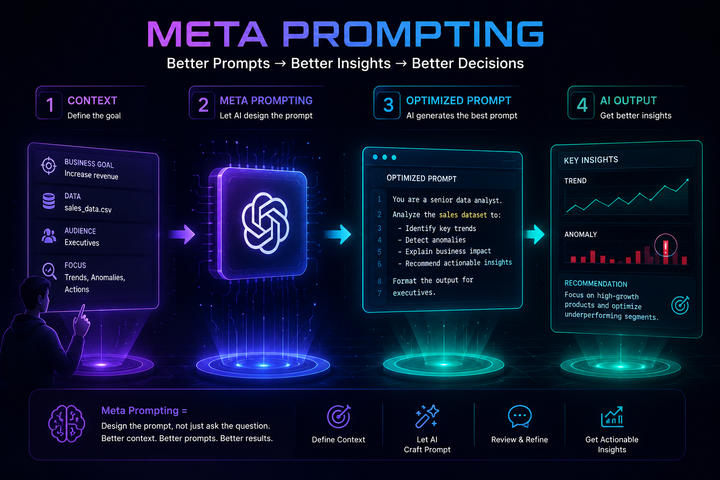

- ให้ Context เยอะขึ้น

- Prompt ให้ชัด

- ใช้ข้อมูลจริงประกอบ (RAG)

- และมีคนตรวจซ้ำในเรื่องสำคัญ

AI ไม่ได้โกหกแต่มันกำลังพยายาม เดาให้ดีที่สุด จากข้อมูลที่มี