ปัญหาของ Deep Learning: Vanishing vs Exploding Gradients

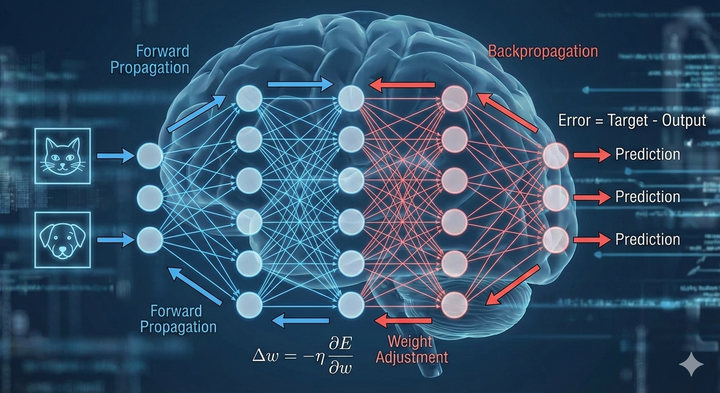

Vanishing and Exploding Gradients เป็นปัญหาที่พบบ่อยตอนฝึก (train) Neural Networks (NN) โดยเฉพาะ Deep NN และ RNN ดังนี้

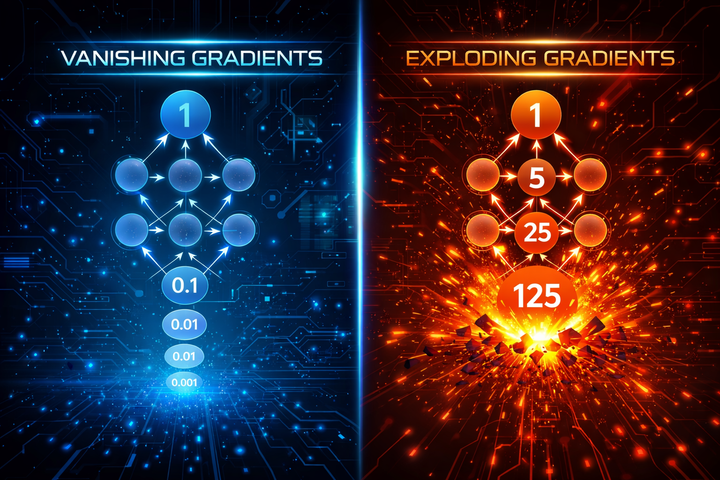

1. Vanishing Gradient

คือ Gradient มีค่าน้อยมาก ๆ ใกล้ศูนย์ → น้ำหนักชั้นต้น ๆ แทบไม่ถูกอัปเดต → โมเดล “เรียนไม่ไป”

เกิ